AR的基本定义

AR,即增强现实技术,它的出现意味着能将计算机技术带到现实当中来,能使科技更“贴近”人们的现实世界的生活,被誉为可能是代替智能手机的,未来的下一个平台。

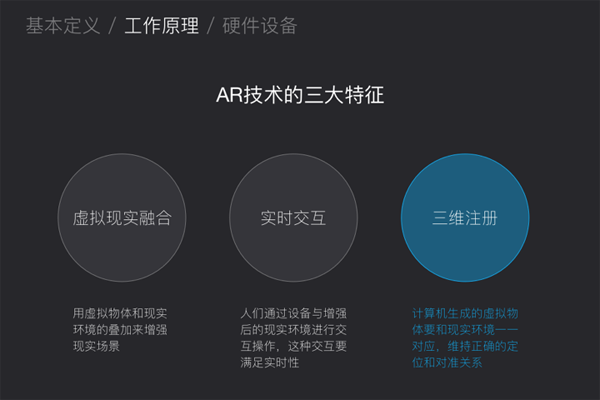

AR是对现实的增强,是虚拟影像和现实影像的融合。AR技术具有虚拟现实融合、实时交互、三维注册三大特征。其中三维注册是其中最重要的特征。

三维注册(也叫三维配准)强调计算机生成物和现实环境的对应关系,虚拟的物体和现实环境的三维位置和大小必须完美融合。

观察科技演进的历史会发现从一开始的工业革命,到现在的信息技术革命以及正在蓬勃发展必定会兴起的认知革命,科技的发展其实意味着现实和虚拟的更好融合。而AR正是这种融合时代的代表性技术。

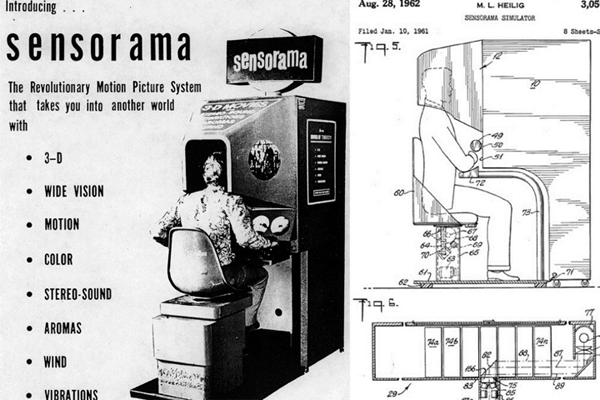

AR/VR技术的起源,可追溯到Morton Heilig在上个世纪五、六十年代所发明的Sensorama Stimulator。他是一名哲学家、电影制作人和发明家。他利用在电影上的拍摄经验设计出了图中这个叫Sensorama Stimulator的机器。Sensorama Stimulator可使用图像、声音、香味和震动,让用户感受在纽约布鲁克林街道上骑着摩托车风驰电掣的场景。这个发明在当时非常超前。以此为契机,AR也展开了它的发展史。来看看各时期AR的发展里程碑吧。

很多人对于VR、AR、MR等概念还是处于混淆的状态,那么到底如何区别这三者呢?

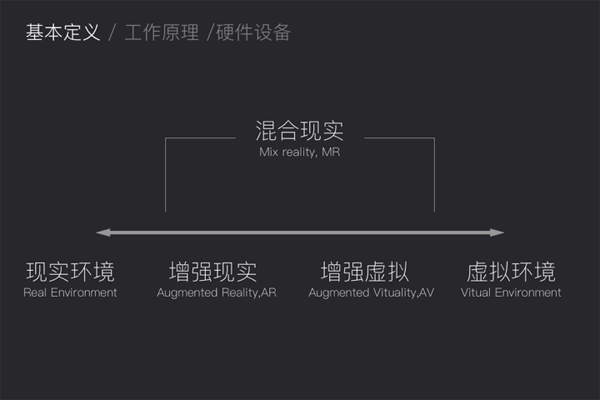

AR和VR的区别,除了从硬件和技术等方面有区别,归根到底是要看到底是对现实的增强还是完全的虚拟化。如若是让人们完全投入进入虚拟世界的沉浸感,则是VR。(如超级学校霸王电影里面2人进入街机里面玩超级玛丽),如若是让虚拟的事物和现实接轨,则是AR。(如超级学校霸王电影里面虚拟世界的英雄形象进入真实世界惩罚坏人)

而MR则是让2者完全的融合,“实时的”进行虚拟和真实的交互。是最终的发展形态。混合现实是实现虚拟和现实的完美融合。目前的MR和AR可以从设备上来进行区分,有以下2点不同。

比如如果虚拟物体的位置能够随设备而移动,做到随身随行,则是MR的实现,如果不能移动,定位在三维世界中,你离开了,虚拟物体还是摆放在刚刚的位置,则是AR。而MR的最高形态,虚拟和现实已经融为一体,有一致的体验,不容易被区分了。

AR的工作原理

在介绍AR的工作原理之前,我们先通过一个例子,让大家有一个简单的认识。

在2009年2月的TED大会上,帕蒂•梅斯(Pattie Maes)和普拉纳夫•米斯特莱(Pranav Mistry)展示了他们研发的AR系统。该系统属于麻省理工学院媒体实验室流体界面小组的研究成果之,他们称之为SixthSense(第六感)。它依靠众多AR系统中常见的一些基本元件来工作:摄像头、小型投影仪、智能手机和镜子。

可以点击这个,查看她的研究。

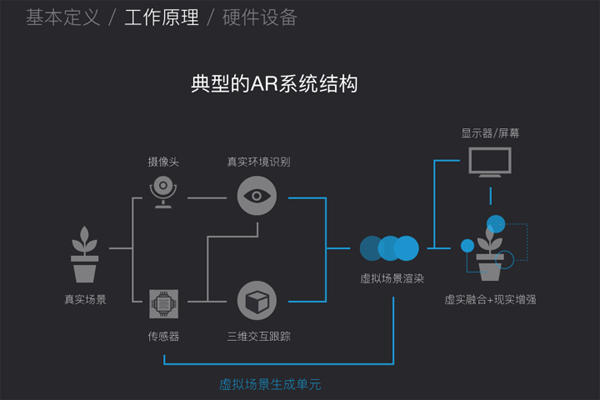

上图是一个典型的AR系统结构,由虚拟场景生成单元以及显示器和头盔等交互设备构成。其中虚拟场景生成单元负责虚拟场景的建模、管理、绘制和其它外设的管理;显示器负责显示虚拟和现实融合后的信号;头部跟踪设备跟踪用户视线变化;交互设备用于实现感官信号及环境控制操作信号的输入输出。

首先摄像头和传感器采集真实场景的视频或者图像,传入后台的处理单元对其进行分析和重构,并结合头部跟踪设备的数据来分析虚拟场景和真实场景的相对位置,实现坐标系的对齐并进行虚拟场景的融合计算;交互设备采集外部控制信号,实现对虚实结合场景的交互操作。系统融合后的信息会实时地显示在显示器中,展现在人的视野中。

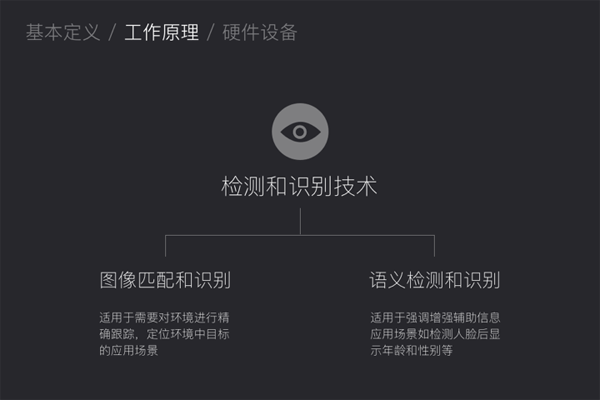

为了保持现实和虚拟的对准,跟踪和识别的技术就显得尤为重要。检测和识别技术包含图像匹配和识别以及语义检测和识别这2点。

跟踪定位技术则分为基于硬件的定位技术和基于视觉的定位技术2点。其中基于视觉的跟踪定位技术最核心的技术,也是主流技术。基于视觉的三维配准包含了这3个发展阶段。

二维图片定位

二维图片定位是指基于平面物体的识别和定位,比如现在市场上很常见的一些AR技术图书,又或则是APP应用。这种技术是将现实世界的一张图片作为定位的锚点,计算机生成的虚拟物体会围绕这个定位点,融入现实环境中。目前基于图片定位的AR是最为成熟的技术,广泛运用在各个地方。目前用在儿童教育图书方面,会比较多。

三维物体定位

然扩展当属三维物体。一些简单的规则三维物体,比如圆柱状可乐罐,同样可以作为虚实结合的载体。对于一些特定的非规则物体,比如人脸,由于有多年的研究积累和海量的数据支持,已经有很多算法可以进行实时精准对齐。

基于SLAM的三维环境定位

对于三维环境的动态的实时的理解是当前AR在技术研究方面最活跃的问题。其核心就是最近火热的“即时定位与地图构建”(SLAM,SimultaneouslyLocalization And Mapping),在无人车,无人机和机器人等领域也起着核心作用。AR中的SLAM比其他领域中一般难度要大很多,主要是因为AR赖以依存的移动端的计算能力和资源比起其他领域来说要弱很多。目前在AR中还是以视觉SLAM为主,其他传感器为辅的局面,尽管这个情况正在改变。

标准的视觉SLAM问题可以这么描述为:把你空投到一个陌生的环境中,你要解决“我在哪”的问题。这里的“我”基本上等同于相机或者眼睛(因为单目,即单相机,请把自己想象成独眼龙),“在”就是要定位(就是localization),“哪”需要一张本来不存在的需要你来构建的地图(就是mapping)。你带着一只眼睛一边走,一边对周边环境进行理解(建图),一边确定在所建地图中的位置(定位),这就是SLAM了。换句话说,在走的过程中,一方面把所见到(相机拍到)的地方连起来成地图,另一方面把走的轨迹在地图上找到。

评论区